L'intelligenza artificiale (IA) ha fatto il suo ingresso nelle nostre vite con una rapidità sorprendente negli ultimi anni, trasformando radicalmente il modo in cui lavoriamo, apprendiamo e creiamo. Se da un lato questi strumenti offrono un supporto senza precedenti, dall'altro sollevano interrogativi cruciali sulle loro implicazioni più profonde, quelle che riguardano la nostra stessa capacità di pensare. Una ricerca del MIT Media Lab ha esplorato questi effetti analizzando l'attività cerebrale durante la scrittura, e i risultati evidenziano un rischio emergente: il debito cognitivo. Questa condizione, dove la comodità offerta dall'IA si traduce in un minor impegno mentale e in una riduzione delle capacità critiche, rappresenta una sfida strategica che merita un'analisi approfondita.

Cosa Si Intende per Debito Cognitivo?

Per comprendere appieno il concetto di "debito cognitivo", è utile fare un'analogia con il mondo fisico. Immagina di avere un muscolo che non alleni mai. Con il tempo, inevitabilmente, questo muscolo perde forza, elasticità e reattività. Il nostro cervello funziona in modo sorprendentemente simile. Il "debito cognitivo" è quella sorta di impoverimento mentale che si accumula quando smettiamo di allenare attivamente il pensiero critico, la memoria, la creatività e la capacità di risolvere problemi in autonomia, perché deleghiamo queste funzioni a una macchina. Invece di sforzarci di elaborare informazioni, analizzare dati o formulare idee originali, ci affidiamo a sistemi di intelligenza artificiale che "pensano" per noi.

Inizialmente, questa delega può apparire come una semplice comodità. Ci sentiamo sollevati dal peso di compiti mentalmente gravosi, guadagnando tempo ed efficienza. Tuttavia, questa apparente facilitazione nasconde un pericolo insidioso: il rischio di un progressivo indebolimento delle nostre facoltà cognitive. È un po' come utilizzare una stampella in modo continuativo: ci permette di muoverci senza sforzo, ma a lungo andare rende la gamba che dovrebbe sostenere il nostro peso più fragile e dipendente dal supporto esterno.

Off-loading Cognitivo: Benefici Immediati e Rischi a Lungo Termine

Il fenomeno dell'"off-loading cognitivo", o "scarico cognitivo", si verifica quando esternalizziamo compiti mentali verso strumenti esterni, siano essi un'agenda elettronica, un navigatore GPS, un motore di ricerca o un modello linguistico avanzato come ChatGPT. I vantaggi immediati sono innegabili: riduzione del carico mentale, maggiore efficienza operativa, ottimizzazione dei tempi e un risparmio di energie che possono essere reindirizzate verso attività percepite come più complesse o gratificanti.

Gentile Direttore, ci è mai capitato di non ricordare il numero di telefono di un nostro familiare perché salvato in rubrica? O di sentirci smarriti senza Google Maps anche in una zona che conosciamo? Ecco, questi rappresentano degli esempi semplici e ricorrenti che dimostrano gli effetti svantaggiosi del cognitive off-loading o “scarico cognitivo”. Questi episodi quotidiani, apparentemente banali, sono indicatori di come l'abitudine a delegare funzioni cognitive possa portare a una loro atrofia.

Tuttavia, il rovescio della medaglia emerge quando questo "scarico" viene utilizzato in modo acritico e sistematico, trasformandosi in una vera e propria dipendenza. L'utilizzo indiscriminato di strumenti di IA, limitando l'impegno mentale personale, può produrre come conseguenza un debito cognitivo. Questo significa che il beneficio a breve termine, ottenuto grazie alla comodità e alla velocità offerte dalla tecnologia, viene "pagato" nel tempo con un indebolimento della capacità critica, una riduzione della profondità di analisi e una diminuzione dell'autonomia di pensiero.

L'Esperimento del MIT: Misurare l'Impatto Cerebrale

Per quantificare e comprendere meglio questi effetti, una ricerca condotta dal MIT Media Lab ha messo a confronto l'attività cerebrale di persone che scrivevano testi in autonomia con quella di chi utilizzava strumenti di intelligenza artificiale. Lo studio ha coinvolto 54 partecipanti, divisi in tre gruppi distinti. Il primo gruppo ("LLM") aveva accesso esclusivo a GPT-4, senza possibilità di usare altri strumenti di ricerca online. Il secondo gruppo ("Search Engine") poteva navigare liberamente sul web con motori di ricerca come Google, ma senza interagire con LLM. Il terzo gruppo ("Brain-only") doveva fare affidamento unicamente sulle proprie capacità cognitive, senza alcun supporto tecnologico esterno.

Durante il test, il loro cervello veniva monitorato con elettroencefalografia (EEG). Chi lavora con il cervello, come un neurochirurgo, sa quanto sia importante mantenerlo vivo e attivo. Dopo un intervento neurochirurgico, ad esempio, stimolare le funzioni cognitive è spesso la chiave per un recupero efficace. Se l'uso passivo dell'IA riduce questa capacità di autoattivarsi, potremmo trovarci davanti a pazienti meno pronti a reagire, meno consapevoli, meno motivati.

Come è Stato Misurato il Debito Cognitivo: La Metodologia dello Studio MIT

Per decodificare i risultati, i ricercatori hanno orchestrato un'analisi a più livelli, intrecciando dati neuroscientifici, linguistici e comportamentali. Mentre un casco EEG a 32 canali mappava in tempo reale il carico cognitivo e l'impegno neurale dei partecipanti, algoritmi di Natural Language Processing (NLP) passavano al setaccio i saggi per svelarne la struttura, il lessico e l'originalità. A completare il quadro, interviste mirate hanno catturato le percezioni soggettive su proprietà e soddisfazione, e una doppia giuria - composta da docenti esperti e un "giudice AI" - ha valutato la qualità dei testi.

L'integrazione di queste diverse prospettive ha permesso di tracciare un profilo completo, svelando le profonde differenze cognitive e comportamentali tra i tre approcci alla scrittura. Un aspetto particolarmente interessante è emerso nella quarta sessione opzionale, dove le regole sono state invertite: i membri del gruppo LLM sono stati privati dell'assistente AI (diventando "LLM-to-Brain"), mentre quelli del gruppo Brain-only hanno avuto accesso a un LLM per la prima volta ("Brain-to-LLM"). Questa inversione è stata progettata per studiare gli effetti dell'adattamento e del potenziale "debito cognitivo", ovvero la difficoltà di tornare a un lavoro puramente autonomo dopo essersi abituati a un supporto esterno.

L'Analisi del Linguaggio: Come l'IA Rende la Scrittura Omogenea

L'analisi del linguaggio naturale (NLP) ha offerto una prospettiva quantitativa sulle differenze tra i saggi prodotti dai tre gruppi. I risultati non lasciano spazio a dubbi: il modo in cui scriviamo cambia radicalmente a seconda dello strumento che utilizziamo, o non utilizziamo.

I saggi del gruppo Brain-only hanno mostrato una variabilità significativamente maggiore nella lunghezza delle parole utilizzate, indicando uno stile di scrittura più personale e meno standardizzato. Al contrario, i gruppi LLM e Search Engine hanno prodotto testi con una variabilità molto più contenuta, suggerendo una maggiore omogeneità linguistica, quasi come se seguissero un canovaccio implicito.

Una tecnica di visualizzazione chiamata PaCMAP ha rivelato che i saggi del gruppo LLM erano linguisticamente molto simili tra loro, formando un cluster denso e compatto. Quelli del gruppo Brain-only, al contrario, erano molto più dispersi, a testimonianza di una maggiore originalità e diversità di approccio.

La formula della Divergenza di Kullback-Leibler (KL), utilizzata per misurare quanto una distribuzione di testo si discosta da un'altra, ha confermato questa tendenza. Per argomenti come "Scelte" e "Coraggio", i testi del gruppo Brain-only divergevano significativamente da quelli degli altri due gruppi. Ciò significa che, senza aiuti esterni, i partecipanti hanno prodotto contenuti linguisticamente unici e distinguibili. Questi dati suggeriscono che, mentre l'intelligenza umana produce naturalmente diversità, gli strumenti tecnologici tendono a incanalare la produzione scritta verso una maggiore omogeneità e prevedibilità.

L'Impronta Digitale dell'AI: N-grammi che Svelano l'Origine

Scavando più a fondo nell'analisi linguistica, emergono due indicatori chiave che tracciano una linea di demarcazione netta tra la scrittura umana autonoma e quella assistita dall'AI: il Riconoscimento di Entità Nominate (NER) e l'analisi degli n-grammi.

Il NER è una tecnica che identifica e classifica elementi specifici nel testo come nomi di persone, organizzazioni, luoghi, date o opere d'arte. L'analisi ha rivelato un uso massiccio di NER da parte del gruppo LLM, i cui saggi erano densi di riferimenti specifici. Il gruppo Search Engine ha utilizzato i NER in misura minore, mentre il gruppo Brain-only, prevedibilmente, ha usato ancora meno NER, con riferimenti legati principalmente all'esperienza personale.

Ancora più rivelatrice è l'analisi degli n-grammi, ovvero sequenze di parole consecutive. È emerso che il gruppo Brain-only ha mostrato una preferenza per n-grammi riflessivi e astratti. Il gruppo Search Engine ha utilizzato termini più concreti e spesso legati a temi sociali ottimizzati per la ricerca. Il gruppo LLM ha mostrato una tendenza a usare frasi fatte e orientate all'azione. Questi pattern linguistici non sono casuali, ma riflettono la natura dello strumento utilizzato.

Uomo vs Macchina: Perché l'AI Non Vede l'Originalità

Stabilire la qualità di un testo è un compito complesso, che va oltre la semplice correzione grammaticale. Implica la valutazione di parametri come l'originalità, la profondità del contenuto, la struttura e lo stile. Nello studio, questa valutazione è stata affidata a una doppia giuria: da un lato, due docenti di inglese esperti, dall'altro, un "giudice AI". Il confronto tra i loro giudizi ha fatto emergere una discrepanza fondamentale nel modo in cui l'uomo e la macchina "percepiscono" la qualità.

I docenti umani hanno notato rapidamente un pattern: molti saggi, sebbene linguisticamente impeccabili e ben strutturati, apparivano "senz'anima". Contenevano idee standard, formulazioni ricorrenti e un'assenza di sfumature personali. Questi elaborati, che i docenti hanno correttamente attribuito all'uso di un LLM, sono stati valutati molto bene per la forma, ma hanno ricevuto punteggi bassi per il contenuto e l'unicità. I docenti hanno premiato l'individualità e la creatività, anche a discapito di una perfezione formale.

Il giudice AI, al contrario, ha mostrato un bias sistematico, dando punteggi alti a quasi tutti i saggi, dimostrando una sorta di "generosità" statistica e faticando a cogliere la differenza tra un testo originale e uno generato dall'IA. Si è creata una "coda" di distribuzione in cui, a fronte di un alto punteggio AI, corrispondeva una valutazione umana molto bassa.

Questi risultati hanno implicazioni profonde per chiunque si affidi all'AI per la creazione o la valutazione di contenuti. Un testo "perfetto" secondo un algoritmo non è necessariamente un testo efficace per un lettore umano. I docenti hanno sottolineato che i saggi del gruppo LLM, pur essendo tecnicamente validi, erano spesso "vuoti". Questo suggerisce che gli attuali modelli, pur eccellendo nella produzione di linguaggio fluente e coerente, non riescono ancora a replicare l'intenzionalità, l'esperienza personale e l'autenticità che caratterizzano la scrittura umana di qualità.

La Collaborazione Umano-IA: Modelli a Confronto

Nonostante i rischi, non si tratta di condannare la tecnologia. Al contrario, credo nel suo potenziale. Come tutte le innovazioni, anche l'IA va usata con consapevolezza. ChatGPT può essere una risorsa incredibile, ma solo se lo usiamo come alleato, non come stampella. Il pensiero umano ha un valore unico: è imperfetto, certo, ma è anche emozione, intuizione, esperienza.

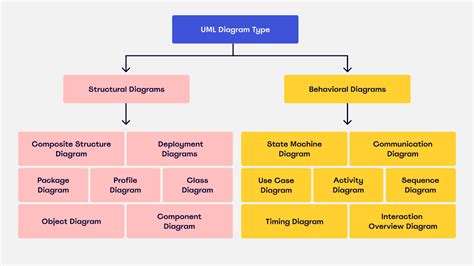

Per affrontare i rischi del debito cognitivo e del deskilling (sviluppo distorto di abilità), è fondamentale definire modelli di collaborazione tra uomo e IA. Come riportato nel citato articolo del NEJM, si distinguono due modalità simboliche: il "modello centauro" e il "modello cyborg".

Nel modello centauro, vi è una netta separazione dei compiti: l'IA fornisce supporto operativo (es: analisi dei dati, stesura di bozze, documenti), ma il giudizio finale e le decisioni restano di competenza umana. Pur partendo da una separazione delle competenze, si rileva una cooperazione tra sistemi di IA e umano.

Il modello cyborg, invece, prevede un'integrazione molto più stretta, con una co-produzione continua tra umano e IA. Questo modello è particolarmente efficiente per attività ripetitive e a basso rischio, ma è esposto al rischio di deskilling e dipendenza.

Cerulli (Deloitte): Con collaborazione tra uomo e generative AI si può creare valore in modo diverso

Promuovere il Pensiero Critico nell'Era dell'IA

Rimane un interrogativo cruciale: come promuovere il pensiero critico, fondamentale baluardo a fronte di un'eccessiva dipendenza dall'IA? Come arginare i fenomeni di deskilling, neverskilling e mis-skilling (sviluppo di abilità errate o inadeguate)?

Un approccio efficace è quello descritto nel metodo "Diagnosis/Discussion/Discourse" (DEDF) applicato nel contesto formativo. In questo approccio:

- Diagnosis/Discussion/Discourse (D): Il docente chiede allo studente una descrizione circa l'uso specifico che ha fatto dell'IA, in particolare di esplicitare il proprio ragionamento, quali diagnosi aveva in mente, che informazioni aveva considerato, come aveva utilizzato l'IA e quali prompt aveva inserito.

- Evidence (E): Si verificano gli output generati dall'IA e si procede a una valutazione delle evidenze cliniche a favore di una certa ipotesi diagnostica, così come delle evidenze a supporto dell'uso di uno specifico sistema di IA.

- Feedback (F): Si chiede di riflettere sulle opportunità di crescita nell'uso dell'IA, come valutare l'utilizzo nel caso specifico e come migliorare l'impiego.

- Teaching (T): Si forniscono insegnamenti mirati sulla base dei risultati emersi e si raccomanda se, quando e come utilizzare l'IA in modo sicuro in futuro. In particolare, si rafforzano le abilità e le competenze, individuando limiti e bias.

- Recommendation for AI engagement (AI): Si forniscono raccomandazioni personalizzate per un uso sicuro dell'IA.

Queste procedure significano sostituire la logica del “trust and go” (fidarsi e andare avanti) con la metodologia del “verify and trust” (verificare e fidarsi), in cui l'output dell'IA viene prima valutato secondo il principio di esplicabilità e poi utilizzato. In questa ottica si acquisiscono nuove competenze o si potenziano quelle esistenti per adattarsi a tecnologie e pratiche emergenti (up-skilling). Si favorisce lo sviluppo di capacità critiche e decisionali, migliorando l'uso di sistemi innovativi di IA.

Come medico, ma anche come persona che ama pensare, scrivere e imparare, sento che è il momento di prenderci cura anche della nostra "igiene cognitiva". L'uso dell'IA deve essere un esercizio per informare il ragionamento, piuttosto che sostituirlo. Prima verificare e poi fidarsi. È questo l'imperativo per navigare il futuro senza smarrire la nostra capacità di pensare autonomamente.